Mengenal Strawberry AI, Bisa Membuat Video Game hingga Senjata Mematikan

OpenAI membuat gebrakan baru dengan memperkenalkan Strawberry AI. Kemampuannya dilipatgandakan hingga tak masuk akal.

Perusahaan yang memperkenalkan ChatGPT, OpenAI, merilis sistem AI yang tidak hanya dirancang untuk memberikan jawaban cepat atas pertanyaan penggunanya, tetapi juga dirancang untuk “berpikir” atau “bernalar” sebelum menjawab. Sistem AI ini disebut o1 atau dijuluki Strawberry.

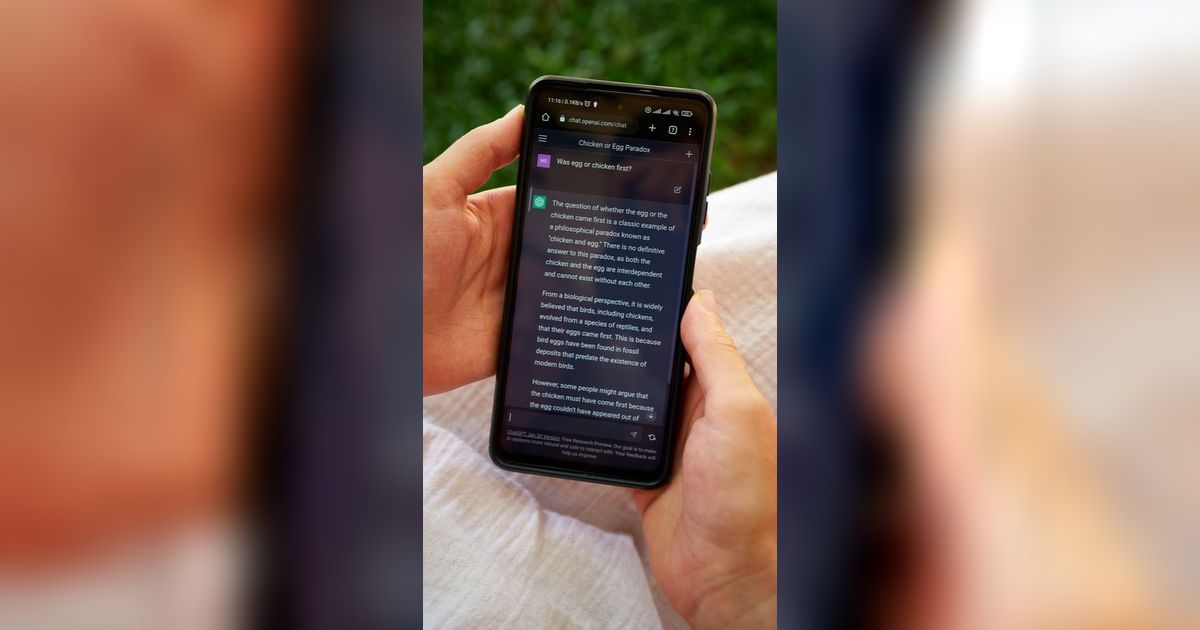

Mengutip Wired, Kamis (19/9), tidak seperti model AI sebelumnya, seperti GPT-4o, saat pengguna mengajukan pertanyaan kepada model “o1” di ChatGPT, pengguna memiliki opsi untuk melihat proses rangkaian pemikiran yang ditulis dalam antarmuka ChatGPT.

-

Siapa yang menggunakan AI untuk menyerang gamer? Di sisi lain, penjahat siber semakin banyak menggunakan AI untuk mengotomatiskan dan mempersonalisasi serangan phishing yang lebih mungkin menarik para gamer muda.

-

Apa yang dibuat oleh AI? Elon Musk, CEO Tesla dan SpaceX, baru-baru ini membagikan sebuah video pertunjukan fashion show yang dihasilkan oleh AI, menampilkan berbagai pemimpin dunia dan tokoh teknologi terkemuka.

-

Apa yang AI dapat ciptakan? Logika membawamu dari A ke B. Imajinasi bisa membawamu ke mana saja.

-

Siapa yang membuat AI ini? Malas menemukan Project December–sebuah alat AI yang dirancang untuk 'mensimulasikan orang yang telah meninggal'.

-

Siapa yang mengembangkan AI yang berbahaya? Pemerintah di seluruh dunia semakin banyak yang memasukkan AI ke dalam alat peperangan. Pemerintah AS mengumumkan pada 22 November bahwa 47 negara bagian telah mendukung deklarasi tentang penggunaan AI yang bertanggung jawab di militer – yang pertama kali diluncurkan di Den Haag pada bulan Februari.

-

Siapa yang mengembangkan AI ini? Para peneliti di Denmark menggunakan data dari jutaan individu untuk membangun model yang dapat memprediksi berbagai peristiwa kehidupan, mulai dari kesehatan hingga kehidupan sosial.

Tetapi, berdasarkan desain, OpenAI menyembunyikan rangkaian pemikiran mentah dari pengguna, sebagai gantinya menyajikan interpretasi yang difilter. Saat memberikan Strawberry perintah, ia akan mulai dengan memberi tahu kita bahwa ia sedang “berpikir”.

Setelah beberapa detik, ia akan menentukan bahwa ia sedang “mendefinisikan variabel” tunggu beberapa detik lagi, dan ia akan mengatakan bahwa ia berada pada tahap “mencari tahu persamaan” dan kita akan mendapatkan jawaban.

Meski dapat menulis kode untuk gim video baru, menurut evaluasi OpenAI, Strawberry dapat membantu orang-orang dengan pengetahuan di bidang tertentu seperti membuat senjata nuklir, senjata biologis, dan senjata kimia.

Sebuah laporan juga memaparkan kemampuan dan resikonya, OpenAI memberi sistem baru tersebut peringkat “sedang” untuk resiko senjata nuklir, biologi, dan kimia. Itu artinya sistem tidak akan memberi tahu orang biasa yang tidak memiliki keterampilan laboratorium cara membuat virus yang mematikan, dikutip dari Vox, Rabu (18/9).

Artinya juga sistem bisa membantu para ahli dengan perencanaan operasional untuk mereproduksi ancaman biologis yang diketahui dan secara umum membuat prosesnya lebih cepat dan mudah.

Dan Hendrycks, Direktur Center for AI Safety, mengatakan dalam pernyataan melalui email bahwa “rilis OpenAI terbaru memperjelas satu hal: resiko serius dari AI bukanlah fantasi fiksi ilmiah yang jauh di masa depan.” Dan OpenAI juga mengatakan, “Kami sadar bahwa kemampuan baru ini dapat menjadi dasar bagi aplikasi yang berbahaya.”

Lantas, apakah Strawberry AI aman atau tidak? Untuk kemampuan AI yang memungkinkan secara aktif “berpikir” tentang aturan keselamatan saat diminta oleh pengguna, jika pengguna mencoba untuk melakukan usaha menipu AI agar menghasilkan konten yang tidak seharusnya dihasilkan, AI dapat menduga dan menolaknya.

Namun masih ada pendapat-pendapat yang membuat model AI tersebut sulit dipercaya.

Reporter magang: Nadya Nur Aulia